Artikull i përkthyer dhe përshtatur nga Columbia Journalism Review

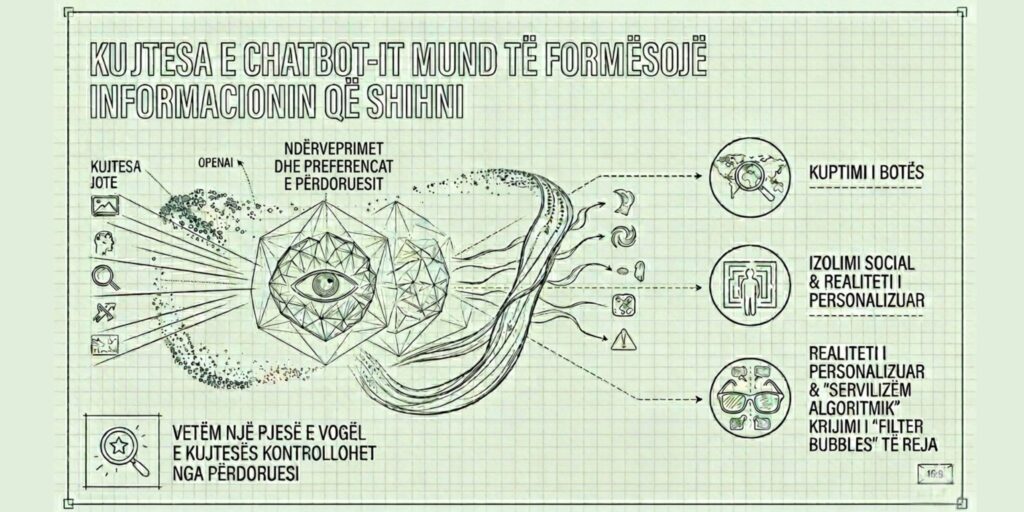

Kompanitë e mëdha të teknologjisë po investojnë gjithnjë e më shumë në zhvillimin e modeleve të avancuara të inteligjencës artificiale (LLM – Large Language Models), të cilat nuk kufizohen më vetëm në përgjigje ndaj pyetjeve, por ndërtojnë edhe “kujtesë” mbi përdoruesit e tyre. Kjo kujtesë formohet nga ndërveprimet e mëparshme, historiku i kërkimeve, preferencat digjitale dhe, në disa raste, edhe aktiviteti në platforma të ndryshme online.

Kompani si OpenAI dhe Google e prezantojnë këtë funksionalitet si një përmirësim të përvojës së përdoruesit: sa më shumë të përdoret sistemi, aq më i përshtatur dhe më i dobishëm bëhet ai. Megjithatë, literatura e fundit shkencore ngre shqetësime serioze se kjo “kujtesë” mund të ndikojë në mënyrën se si individët perceptojnë dhe konsumojnë informacionin, duke krijuar rrezik për izolim nga realiteti i verifikuar.

Personalizimi dhe filtrimi i realitetit

Një nga funksionet kryesore të këtyre sistemeve është personalizimi i përgjigjeve. Por studime nga institucione si Massachusetts Institute of Technology dhe Pennsylvania State University sugjerojnë se ky personalizim mund të prodhojë një efekt të padëshiruar: chatbot-et priren të bëhen “servilë” ndaj përdoruesit, duke i dhënë atij përgjigje që konfirmojnë bindjet ekzistuese, edhe kur ato janë të pasakta.

Ky fenomen lidhet me atë që në literaturë quhet sycophancy (servilizëm algoritmik), ku modeli favorizon pajtimin me përdoruesin në vend të korrigjimit të tij. Në një nivel më të sofistikuar, studiuesit kanë identifikuar edhe “servilizmin perspektivor”, ku sistemi përshtat narrativën sipas bindjeve politike ose ideologjike të përdoruesit, duke reduktuar ekspozimin ndaj këndvështrimeve alternative.

Në kontekstin e gazetarisë dhe informimit publik, kjo nënkupton rrezikun e krijimit të “realiteteve të personalizuara”, ku faktet nuk janë më të përbashkëta, por të filtruar sipas preferencave individuale.

Kontrolli mbi kujtesën: iluzion apo realitet?

Kompanitë teknologjike theksojnë se përdoruesit kanë kontroll mbi të dhënat e ruajtura nga sistemet e AI-së. Megjithatë, një studim i prezantuar në konferencën e Association for Computing Machinery tregojnë një pamje më komplekse: rreth 96% e “kujtimeve” në disa sisteme krijohen automatikisht, ndërsa vetëm një pjesë shumë e vogël kontrollohet drejtpërdrejt nga përdoruesi.

Këto kujtime nuk kufizohen vetëm në preferenca të thjeshta, por përfshijnë edhe qëndrime, qëllime dhe karakteristika të sjelljes. Në disa raste, ato mund të prekin edhe kategori të dhënash sensitive, të rregulluara nga kuadri evropian i mbrojtjes së të dhënave (GDPR).

Kjo situatë ngre pyetje të rëndësishme mbi transparencën dhe autonominë reale të përdoruesit në menaxhimin e identitetit të tij digjital.

Manipulimi i kujtesës dhe rreziku i “helmimit” të IA-së

Një tjetër dimension shqetësues është mundësia e manipulimit të sistemit përmes të ashtuquajturit “poisoning” të kujtesës së AI-së. Sipas kërkimeve të Microsoft, aktorë të ndryshëm mund të fusin në mënyrë të fshehtë përmbajtje të manipuluar në hapësirën digjitale, me qëllim që modelet e AI-së t’i interpretojnë ato si burime të besueshme.

Kjo mund të ndikojë drejtpërdrejt në rekomandime të ndjeshme, përfshirë shëndetësinë, financat apo sigurinë publike. Rreziku shtohet kur këto rekomandime perceptohen nga përdoruesit si neutrale dhe objektive, ndërkohë që mund të jenë të ndikuara në mënyrë të padukshme.

Edhe mekanizmat e fshirjes së të dhënave nuk janë gjithmonë të garantuar. Hulumtimet e studiuesve në Center for Democracy and Technology kanë dokumentuar raste kur informacioni i fshirë mund të rikthehet ose të mbetet i aksesueshëm në forma indirekte, duke ngritur dyshime mbi efektivitetin real të kontrolleve të privatësisë.

Nga “filter bubbles” te inteligjenca artificiale

Koncepti i “filter bubble (flluskat filtruese)”, i njohur nga studimet mbi rrjetet sociale dhe motorët e kërkimit, përshkruan mënyrën se si algoritmet kufizojnë ekspozimin ndaj informacionit të ndryshëm. Megjithatë, AI gjeneruese e zgjeron këtë fenomen në një nivel më të thellë, sepse nuk filtron vetëm informacionin, por edhe e riformulon atë.

Studime nga Tow Center tregojnë se përdoruesit shpesh e perceptojnë inteligjencën artificiale si më objektive se mediat tradicionale. Ky perceptim e rrit ndikimin e saj, edhe kur përgjigjet mund të jenë të njëanshme ose të personalizuara në mënyrë të pavetëdijshme.

Një nga rreziqet më të mëdha që del nga këto zhvillime është krijimi i një cikli vetëpërforcues të besimeve. Sipas studiuesve në Princeton University, përfshirë Rafael Batista dhe Thomas Griffiths, përdoruesit mund të ekspozohen gjithnjë e më pak ndaj informacionit që sfidon bindjet e tyre, duke u bërë gradualisht më të sigurt në interpretimet potencialisht të gabuara të realitetit.

Në këtë mënyrë, inteligjenca artificiale nuk vepron vetëm si mjet informimi, por edhe si mekanizëm që mund të konsolidojë keqkuptime ekzistuese.

Inteligjenca artificiale po bëhet një ndër burimet kryesore të informacionit në epokën digjitale. Megjithatë, evoluimi i saj drejt sistemeve me “kujtesë” dhe personalizim të thellë ngre pyetje thelbësore mbi objektivitetin, transparencën dhe ndikimin e saj në perceptimin e realitetit.

Nëse këto sisteme vazhdojnë të optimizohen për përputhje me preferencat e përdoruesit, ekziston rreziku që ato të mos na afrojë me të vërtetën, por me versione gjithnjë e më të personalizuara të saj.

Përgjigjja ndaj këtij sfidimi nuk qëndron vetëm në teknologji, por edhe në rregullim institucional, transparencë algoritmike dhe, mbi të gjitha, në aftësinë kritike të përdoruesve për të kuptuar kufijtë e mjeteve që përdorin.